本文将引导用户在云平台上完成 OpenClaw 配置模型。

配置模型

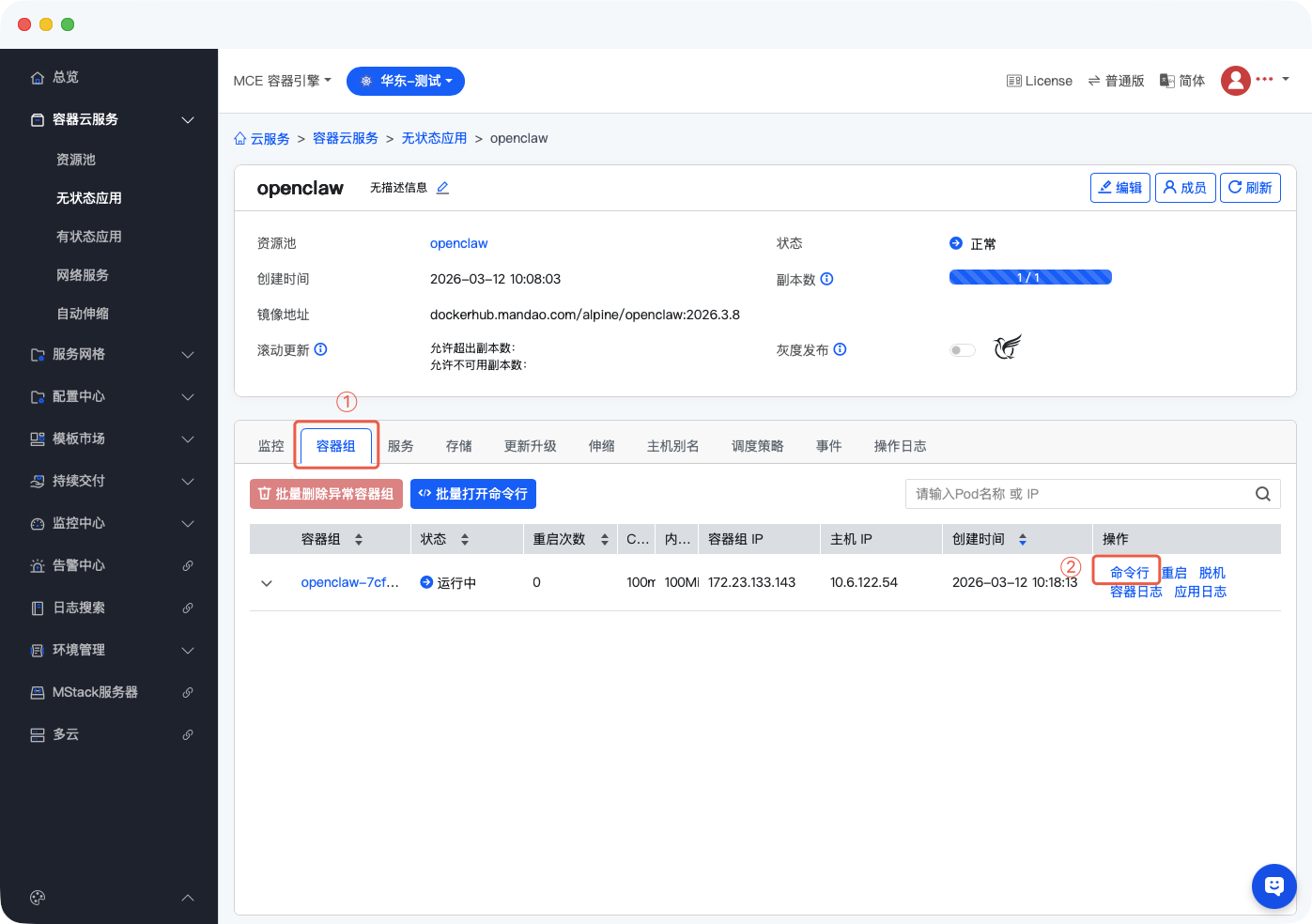

- 进入

无状态应用,选择openclaw资源池,找到openclaw应用,点击进入应用详情页。

- 进入

容器组选择卡,点击实例命令行,进入控制台

- 通过在

/root/.openclaw/openclaw.json文件中追加内容,配置模型(以模型提供商ollama中qwen3.5:2b模型为例),追加的内容如下:

{

...

"models": {

"mode": "merge",

"providers": {

"ollama": {

"baseUrl": "#模型地址#",

"apiKey": "ollama-local",

"api": "ollama",

"models": [

{

"id": "qwen3.5:2b",

"name": "QWen3.5 2b",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 40960

}

]

}

}

}

...

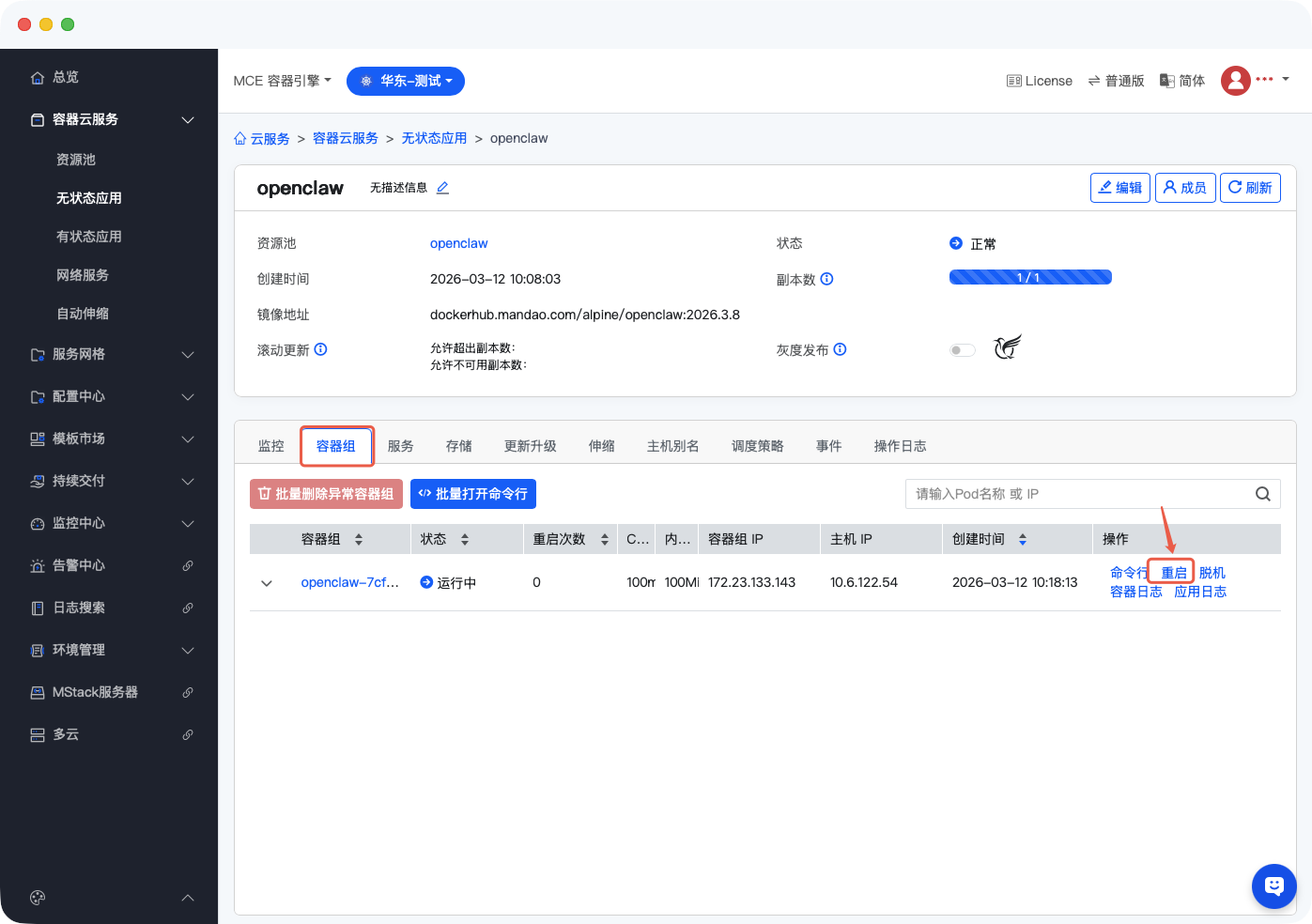

}- 在

容器组选择卡,点击实例重启,重启成功后配置才生效。

测试模型

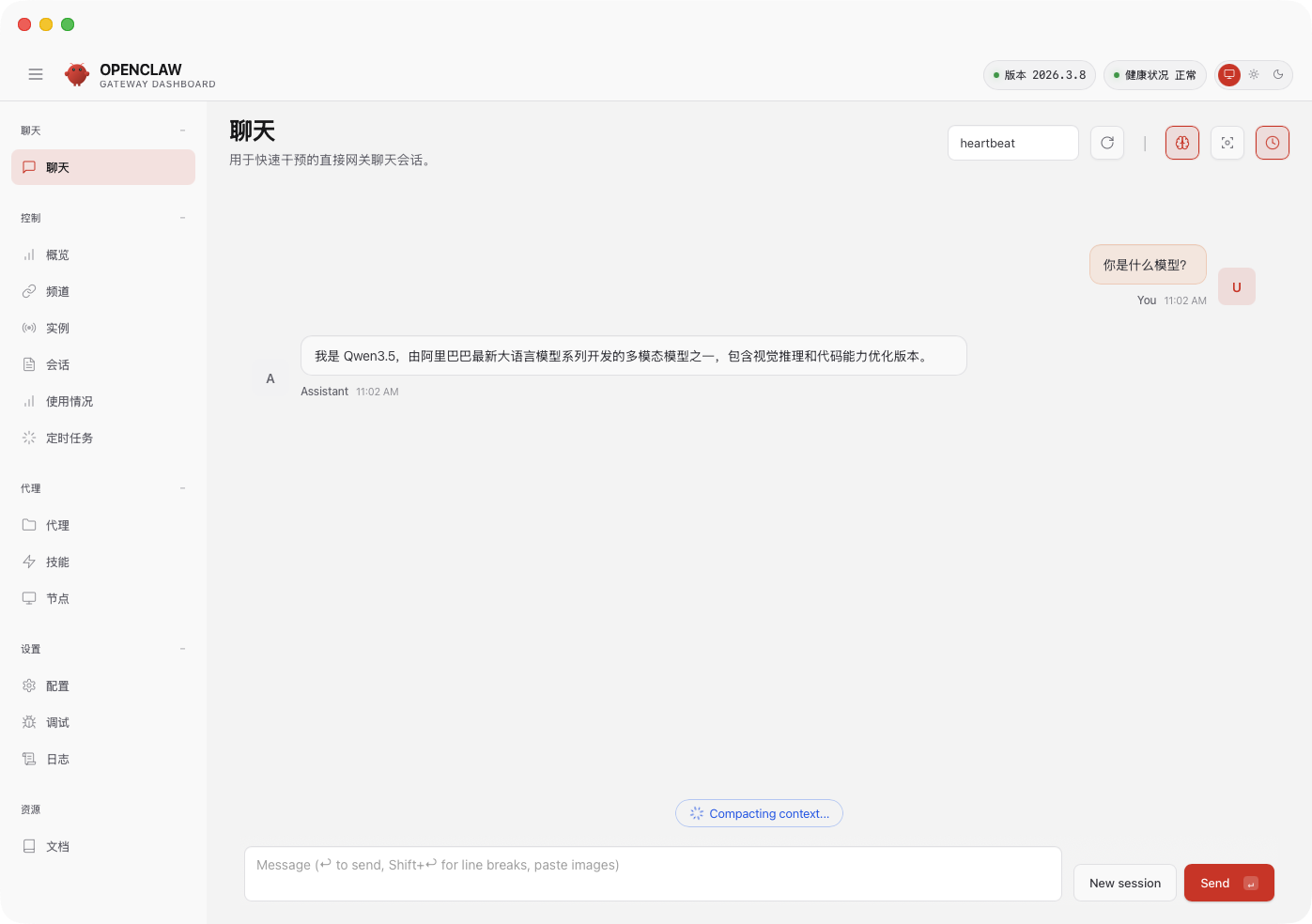

打开OpenClaw页面,进入聊天菜单,在对话框中输入信息,如”你是什么模型?”。

如果能返回对话信息,则配置模型成功。

作者:魏巍 创建时间:2026-03-11 19:43

最后编辑:吴升斌 更新时间:2026-03-13 11:01

最后编辑:吴升斌 更新时间:2026-03-13 11:01